@think

您可以在提示前加上 @think 以首先从 DeepSeek Reasonser 获取思考过程,然后将思考过程发送给您当前使用的 LLM,以基于思考过程获得答案。

使用哪个模型

默认情况下,它会自动检测您设置中的官方 DeepSeek R1 API 和 Volcengine DeepSeek R1 API。(默认使用 Volcengine)

如果您使用 Volcengine,模型名称应包含 r1(不区分大小写),以便可以将其识别为 DeepSeek R1。

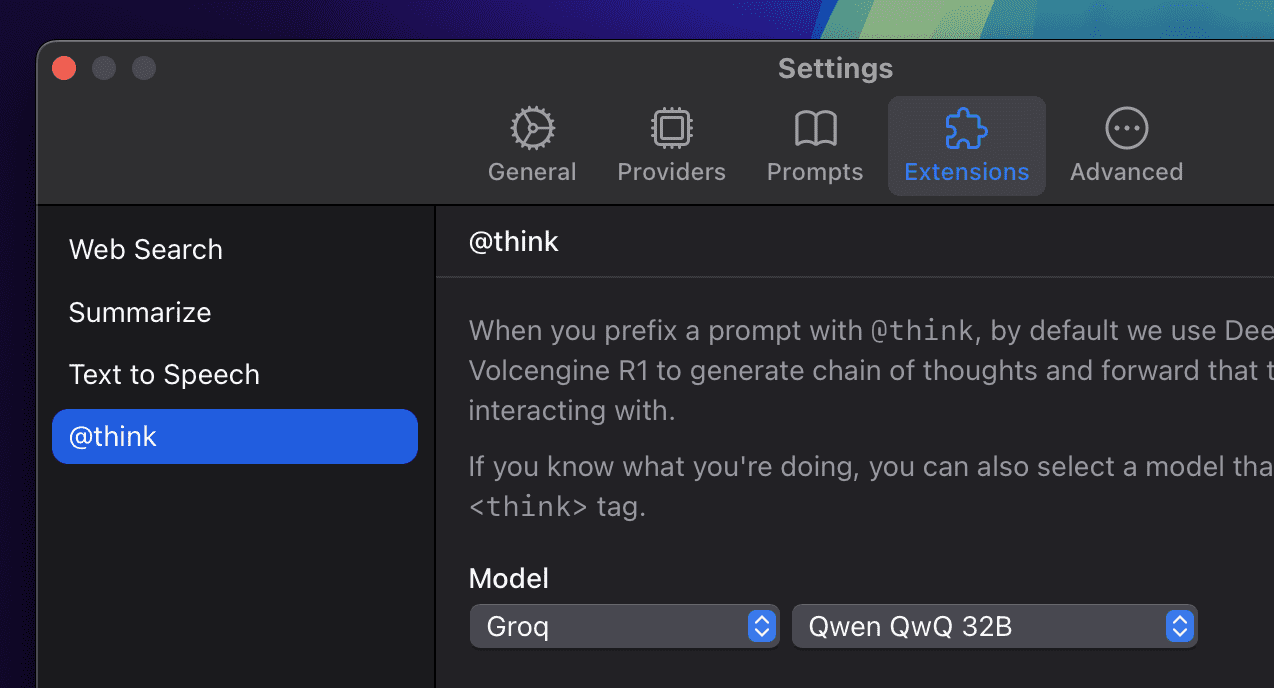

您还可以在设置中手动选择一个在 <think> 标签中输出思考链的模型:

如何使用?

@think 数一下 strawberry 中的 r这是如何工作的?

当使用 DeepSeek Reasoner 或 Volcengine R1 时,我们将 max_tokens 限制为 1 以防止生成实际答案,因为我们只对提取推理过程感兴趣。对于手动选择的模型,我们配置 </think> 的停止序列,以在思考过程完成后终止生成。

获取这些想法后,我们将这个推理链前置到您的原始提示中,并将组合输入发送到您当前选择的模型,以生成最终响应。

支持的模型必须支持以下任一项:

- 将

max_tokens限制为1并仍然输出推理内容。 - 或者

<think>标签,以便我们可以使用停止序列来终止生成。

支持 max_tokens: 1 的模型:

- DeepSeek Reasoner

- Volcengine DeepSeek R1

支持 <think> 标签的提供商:

- Ollama

- LM Studio

- Groq

- Together AI

经测试不支持 <think> 标签的提供商:

- SiliconFlow

- OpenRouter

其他我不了解的,如果您测试了其他提供商,请告诉我。